Krypbarhet & Indexerbarhet: Vad de är & Hur de påverkar SEO

Vad är krypbarhet?

Krypbarheten för en webbsida avser hur lätt sökmotorer (som Google) kan upptäcka sidan.

Google upptäcker webbsidor genom en process som kallas krypning. Det använder datorprogram som kallas webkrypare (även kallade botar eller spindlar). Dessa program följer länkar mellan sidor för att upptäcka nya eller uppdaterade sidor.

Indexering sker vanligtvis efter krypning.

Vad är indexerbarhet?

Indexerbarheten för en webbsida betyder att sökmotorer (som Google) kan lägga till sidan i sin index.

Processen att lägga till en webbsida i en index kallas indexering. Det betyder att Google analyserar sidan och dess innehåll och lägger till det i en databas med miljarder sidor (kallad Google-indexet).

Hur påverkar krypbarhet och indexerbarhet SEO?

Både krypbarhet och indexerbarhet är avgörande för SEO.

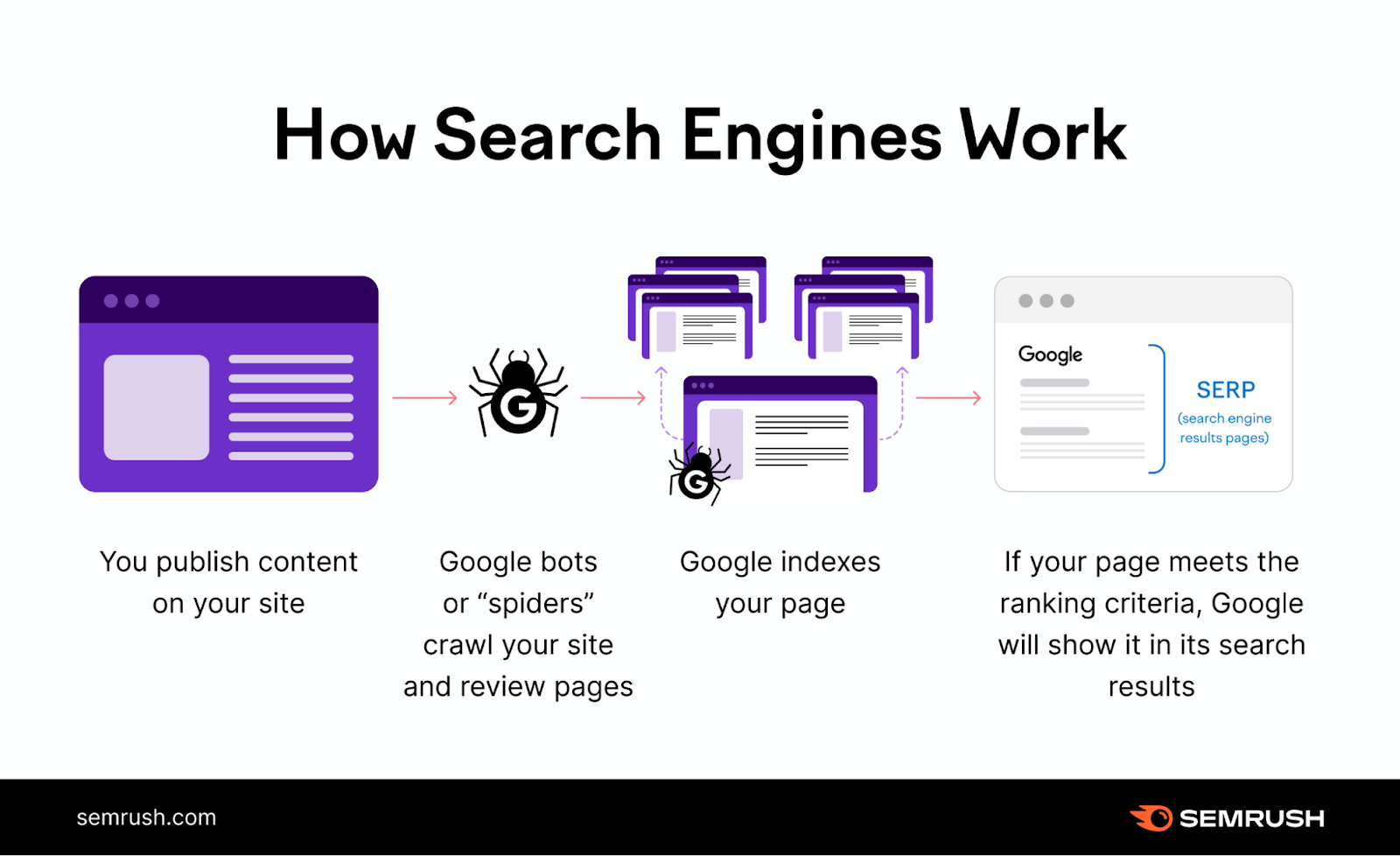

Här är en enkel illustration som visar hur Google fungerar:

Först kryper google sidan. Sedan indexerar den den. Endast då kan den rangordna sidan för relevanta sökfrågor.

Med andra ord: Utan att först krypas och indexeras kommer sidan inte att rangordnas av Google. Inga rankningar = ingen sökmotortrafik.

Matt Cutts, Googles tidigare chef för webspam, förklarar processen i den här videon:

Det är ingen överraskning att en viktig del av SEO är att se till att din webbplats sidor är krypbara och indexerbara.

Men hur gör man det?

Börja med att genomföra en teknisk SEO-granskning av din webbplats.

Använd Semrushs Site Audit-verktyg för att hjälpa dig att upptäcka problem med krypbarhet och indexerbarhet. (Vi kommer att ta upp detta i detalj senare i det här inlägget.)

Upptäck problem med krypbarhet och indexerbarhet

med Site Audit-verktyget

Vad påverkar krypbarhet och indexerbarhet?

Interna länkar

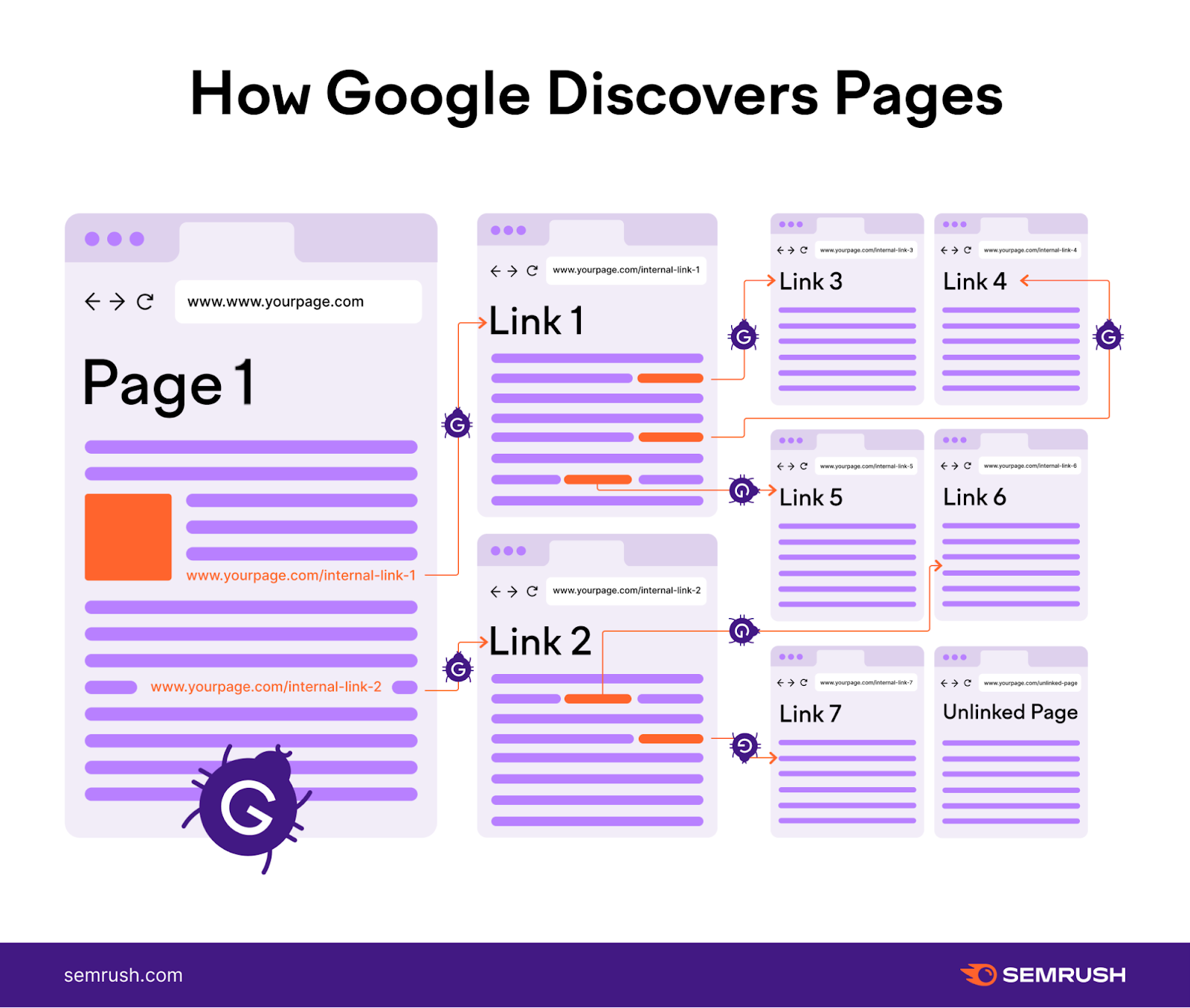

Interna länkar har en direkt inverkan på krypbarheten och indexerbarheten för din webbplats.

Kom ihåg—sökmotorer använder botar för att krypa och upptäcka webbsidor. Interna länkar fungerar som en karta som leder botarna från en sida till en annan inom din webbplats.

Välplacerade interna länkar gör det enklare för sökmotorsbotar att hitta alla sidor på din webbplats.

Se därför till att varje sida på din webbplats är länkad från någon annanstans inom din webbplats.

Börja med att inkludera en navigationsmeny, sidfotlänkar och kontextuella länkar inom ditt innehåll.

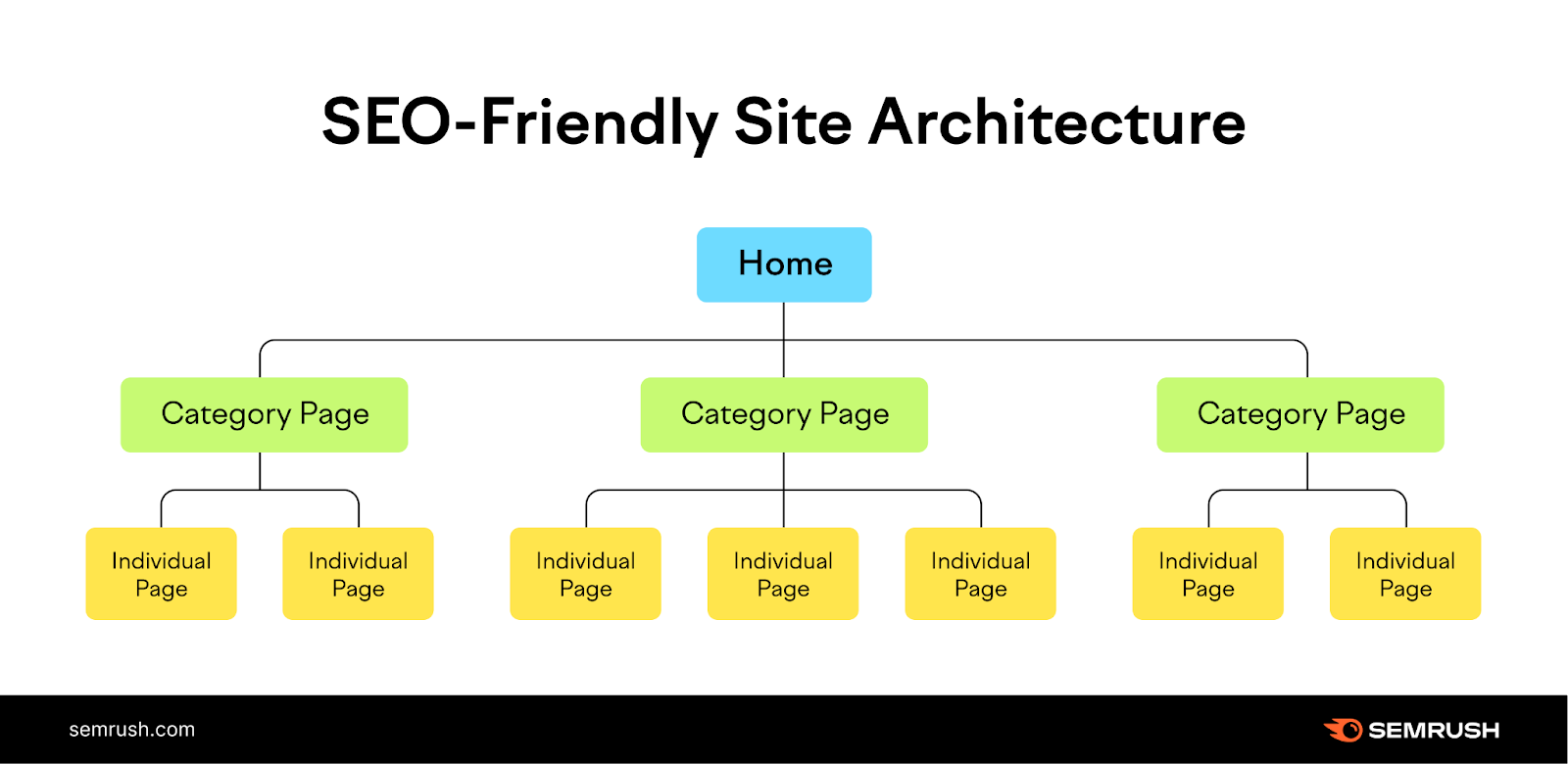

Om du är i de tidiga stadierna av webbplatsutveckling kan det att skapa en logisk sajtstruktur också hjälpa dig att bygga en stark grund för interna länkar.

En logisk sajtstruktur organiserar din webbplats i kategorier. Sedan länkar dessa kategorier till individuella sidor på din webbplats.

På så sätt:

Hemsidan kopplar till sidor för varje kategori. Sedan kopplar sidor för varje kategori till specifika under sidor på sajten.

Genom att anpassa den här strukturen bygger du en solid grund för sökmotorer att enkelt navigera och indexera ditt innehåll.

Robots.txt

Robots.txt är som en vakt vid ingången till en fest.

Det är en fil på din webbplats som berättar för sökmotorsbotar vilka sidor de kan komma åt.

Här är ett exempel på en robots.txt-fil:

User-agent: *

Allow:/blog/

Disallow:/blog/admin/

Låt oss förstå varje komponent i den här filen.

- User-agent: *: Den här raden anger att reglerna gäller för alla sökmotorsbotar

- Allow: /blog/: Det här direktivet tillåter sökmotorsbotar att krypa sidor inom ”/blog/”-katalogen. Med andra ord är alla blogginlägg tillåtna att krypas

- Disallow: /blog/admin/: Det här direktivet berättar för sökmotorsbotar att inte krypa det administrativa området i bloggen

När sökmotorer skickar sina botar för att utforska din webbplats kollar de först robots.txt-filen för att se efter restriktioner.

Var försiktig så att du inte oavsiktligt blockerar viktiga sidor som du vill att sökmotorer ska hitta. Såsom dina blogginlägg och vanliga webbplatssidor.

Dessutom, även om robots.txt kontrollerar krypbarhet, påverkar det inte direkt indexerbarheten för din webbplats.

Sökmotorer kan fortfarande upptäcka och indexera sidor som är länkade från andra webbplatser, även om de sidorna är blockerade i robots.txt-filen.

För att säkerställa att vissa sidor, som pay-per-click (PPC)-landningssidor och ”tack”-sidor, inte indexeras, implementera en ”noindex”-tagg.

Läs vår guide till meta robots-tagg för att lära dig om den här taggen och hur man implementerar den.

XML-sitemap

Din XML-sitemap spelar en avgörande roll i att förbättra krypbarheten och indexerbarheten för din webbplats.

Den visar sökmotorsbotar alla viktiga sidor på din webbplats som du vill ska krypas och indexeras.

Det är som att ge dem en skattkarta för att upptäcka ditt innehåll enklare.

Inkludera därför alla dina väsentliga sidor i din sitemap. Inklusive de som kanske är svåra att hitta genom vanlig navigering.

Detta säkerställer att sökmotorsbotar kan krypa och indexera din webbplats effektivt.

Innehållskvalitet

Innehållskvalitet påverkar hur sökmotorer kryper och indexerar din webbplats.

Sökmotorsbotar älskar högkvalitativt innehåll. När ditt innehåll är välskrivet, informativt och relevant för användare kan det locka mer uppmärksamhet från sökmotorer.

Sökmotorer vill leverera de bästa resultaten till sina användare. Därför prioriterar de att krypa och indexera sidor med toppkvalitativt innehåll.

Fokusera på att skapa originellt, värdefullt och välskrivet innehåll.

Använd korrekt formatering, tydliga rubriker och organiserad struktur för att göra det enkelt för sökmotorsbotar att krypa och förstå ditt innehåll.

För mer råd om att skapa toppkvalitativt innehåll, kolla in vår guide till kvalitetsinnehåll.

Tekniska problem

Tekniska problem kan förhindra sökmotorsbotar från att effektivt krypa och indexera din webbplats.

Om din webbplats har långa sidladdningstider, trasiga länkar eller omdirigeringsloopar kan det hindra botarnas förmåga att navigera din webbplats.

Tekniska problem kan också förhindra sökmotorer från att korrekt indexera dina webbsidor.

Till exempel, om din webbplats har problem med dubblettinnehåll eller använder kanoniska taggar på fel sätt kan sökmotorer ha svårt att förstå vilken version av en sida som ska indexeras och rangordnas.

Problem som dessa är skadliga för din webbplats synlighet i sökmotorer. Identifiera och fixa dessa problem så snart som möjligt.

Hur man hittar problem med krypbarhet och indexerbarhet

Använd Semrushs Site Audit-verktyg för att hitta tekniska problem som påverkar din webbplats krypbarhet och indexerbarhet.

Verktyget kan hjälpa dig att hitta och fixa problem som:

- Dubblettinnehåll

- Omdirigeringsloopar

- Trasiga interna länkar

- Serverfel

Och mer.

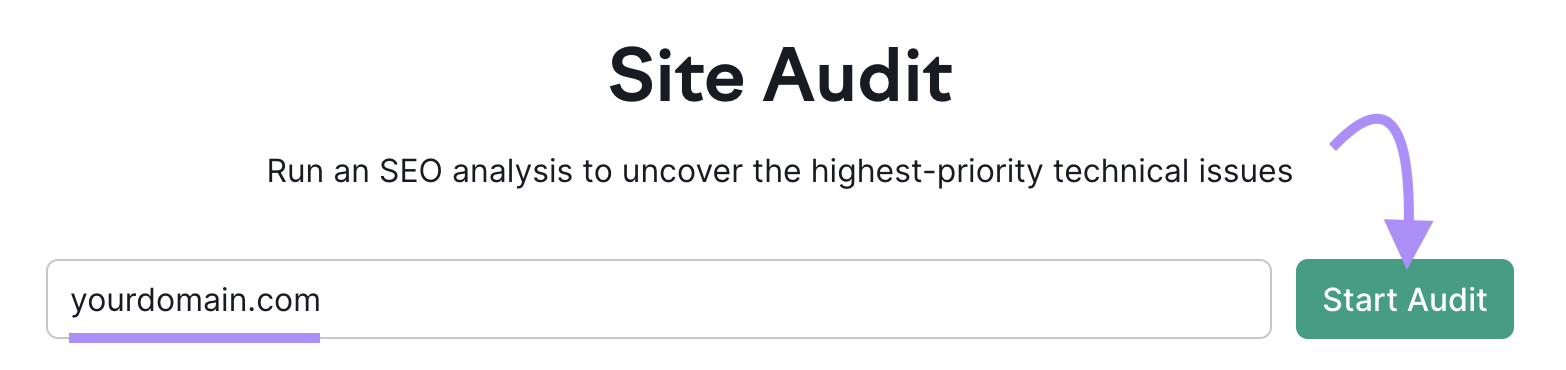

För att börja, ange din webbplats URL och klicka på “Starta granskning.”

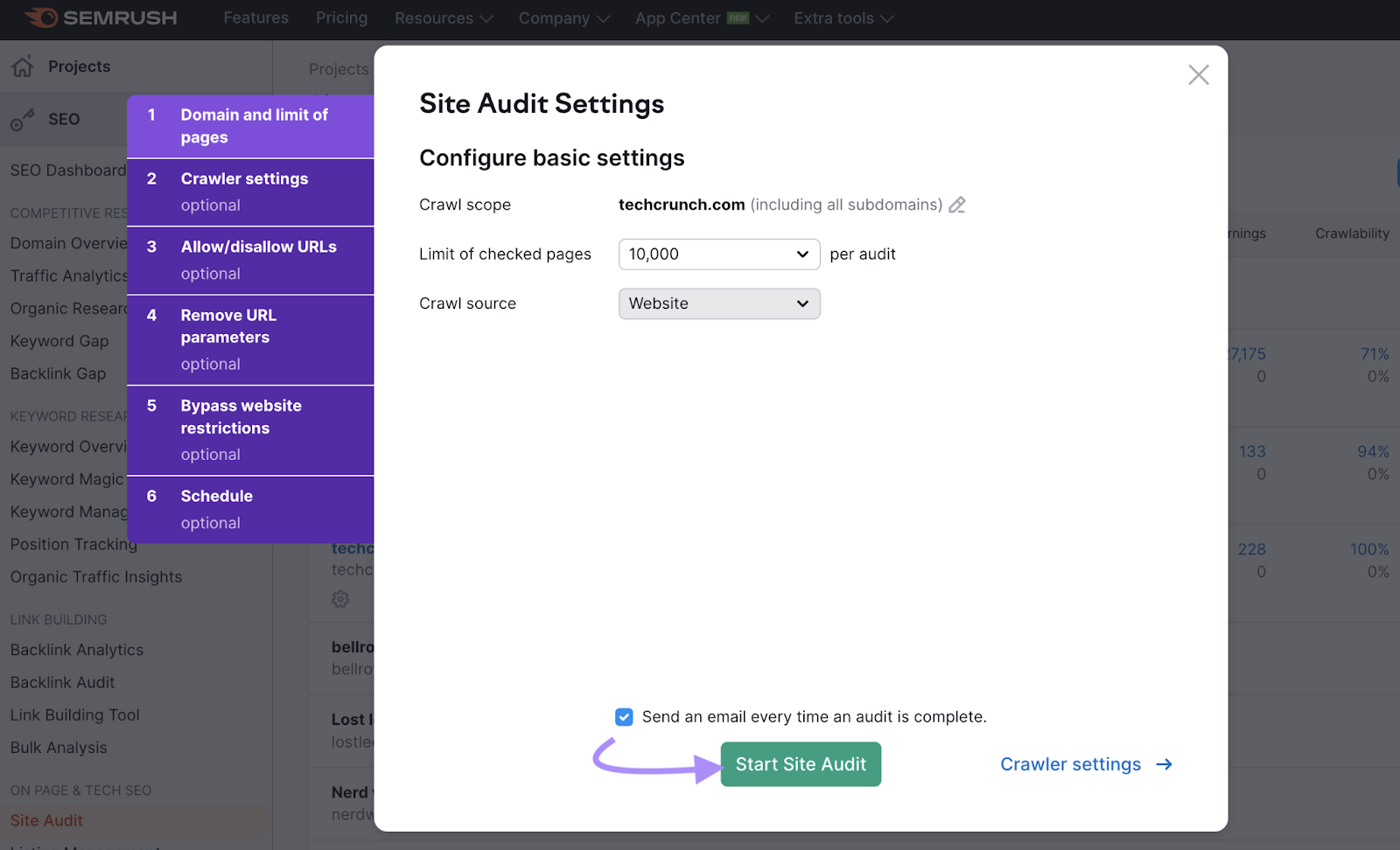

Nästa, konfigurera dina granskningsinställningar. När du är klar, klicka på “Starta sajtsgranskning.”

Verktyget kommer att börja granska din webbplats för tekniska problem. Efter slutförandet kommer det att visa en översikt över din webbplats tekniska hälsa med en ”Site Health”-mätvärde.