Crawlbarkeit & Indexierbarkeit: Was sie sind & wie sie SEO beeinflussen

Was ist Crawlbarkeit?

Die Crawlbarkeit einer Webseite bezieht sich darauf, wie einfach Suchmaschinen (wie Google) die Seite entdecken können.

Google entdeckt Webseiten durch einen Prozess namens Crawling. Es verwendet Computerprogramme namens Web-Crawler (auch Bots oder Spiders genannt). Diese Programme folgen Links zwischen Seiten, um neue oder aktualisierte Seiten zu entdecken.

Das Indexieren folgt normalerweise auf das Crawling.

Was ist Indexierbarkeit?

Die Indexierbarkeit einer Webseite bedeutet, dass Suchmaschinen (wie Google) die Seite zu ihrem Index hinzufügen können.

Der Prozess, eine Webseite zu einem Index hinzuzufügen, heißt Indexieren. Das bedeutet, dass Google die Seite und ihren Inhalt analysiert und sie zu einer Datenbank mit Milliarden von Seiten hinzufügt (dem Google-Index).

Wie beeinflussen Crawlbarkeit und Indexierbarkeit SEO?

Sowohl Crawlbarkeit als auch Indexierbarkeit sind entscheidend für SEO.

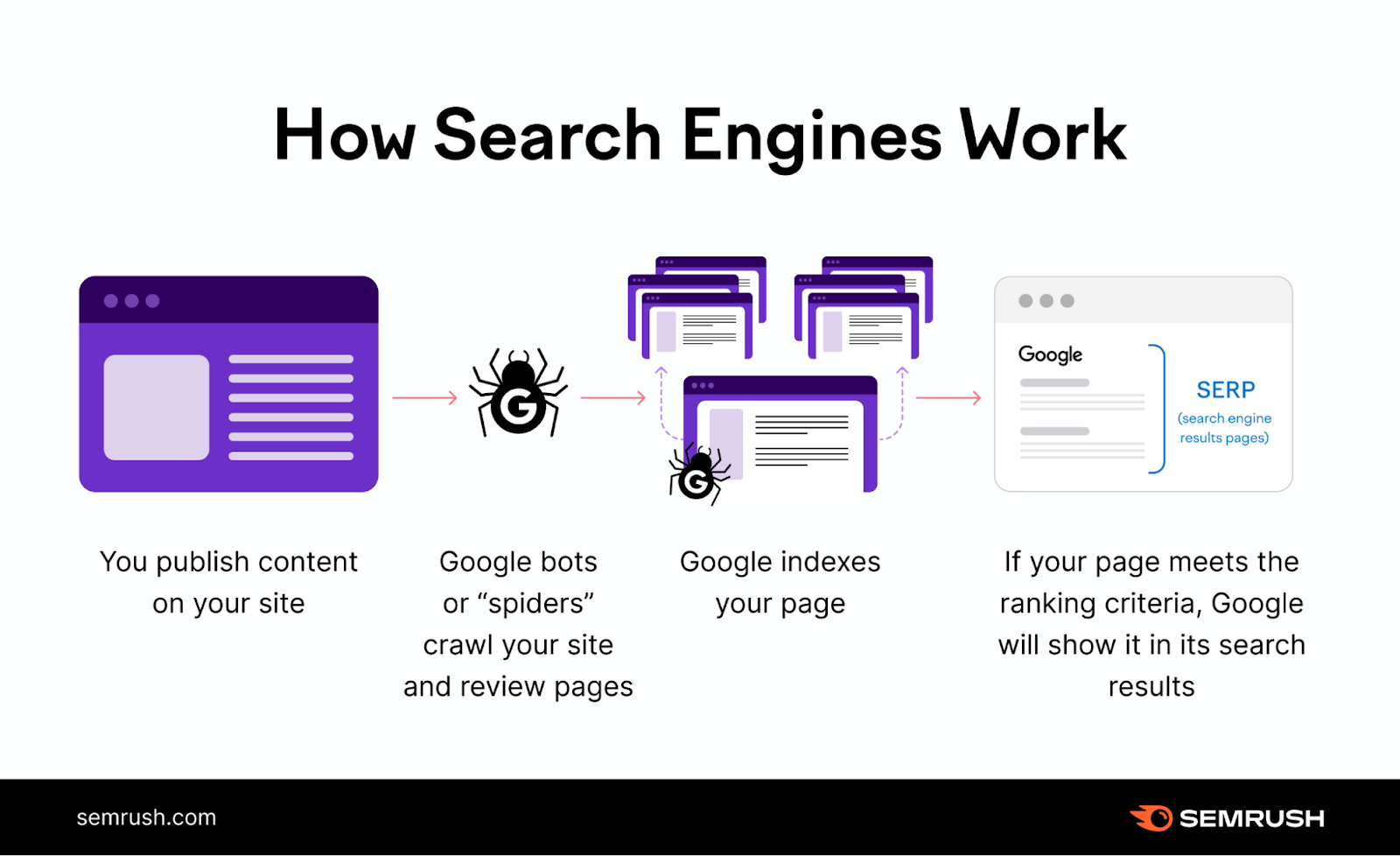

Hier ist eine einfache Illustration, die zeigt, wie Google funktioniert:

Zuerst crawlt Google die Seite. Dann indexiert es sie. Erst dann kann es die Seite für relevante Suchanfragen ranken.

Mit anderen Worten: Ohne vorheriges Crawling und Indexieren wird die Seite nicht von Google gerankt. Keine Rankings = kein Suchverkehr.

Matt Cutts, der ehemalige Leiter der Web-Spam-Abteilung bei Google, erklärt den Prozess in diesem Video:

Es ist kein Wunder, dass ein wichtiger Teil von SEO darin besteht, sicherzustellen, dass die Seiten Ihrer Website crawlbar und indexierbar sind.

Aber wie macht man das?

Beginnen Sie mit einer technischen SEO-Prüfung Ihrer Website.

Verwenden Sie das Site Audit-Tool von Semrush, um Crawlbarkeits- und Indexierbarkeitsprobleme zu entdecken. (Wir gehen später in diesem Beitrag detailliert darauf ein.)

Erkennen Sie Crawlbarkeits- und Indexierbarkeitsprobleme

mit dem Site Audit Tool

Was beeinflusst Crawlbarkeit und Indexierbarkeit?

Interne Links

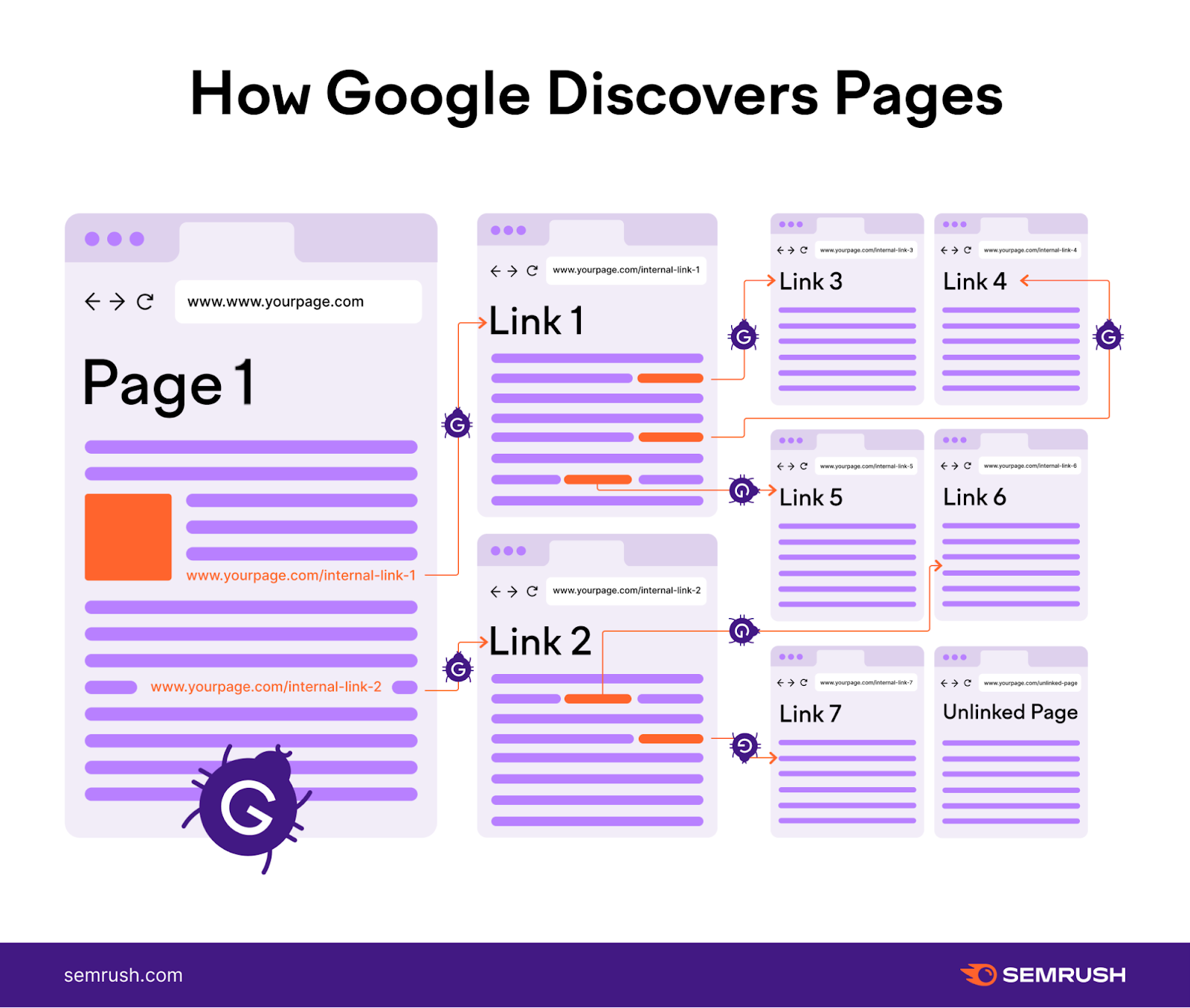

Interne Links haben einen direkten Einfluss auf die Crawlbarkeit und Indexierbarkeit Ihrer Website.

Denken Sie daran – Suchmaschinen verwenden Bots, um Webseiten zu crawlen und zu entdecken. Interne Links wirken wie eine Landkarte, die die Bots von einer Seite zur anderen innerhalb Ihrer Website führt.

Gut platzierte interne Links erleichtern es Suchmaschinen-Bots, alle Seiten Ihrer Website zu finden.

Stellen Sie also sicher, dass jede Seite auf Ihrer Website von einer anderen Stelle innerhalb Ihrer Website verlinkt wird.

Beginnen Sie damit, ein Navigationsmenü, Footer-Links und kontextuelle Links innerhalb Ihres Inhalts einzufügen.

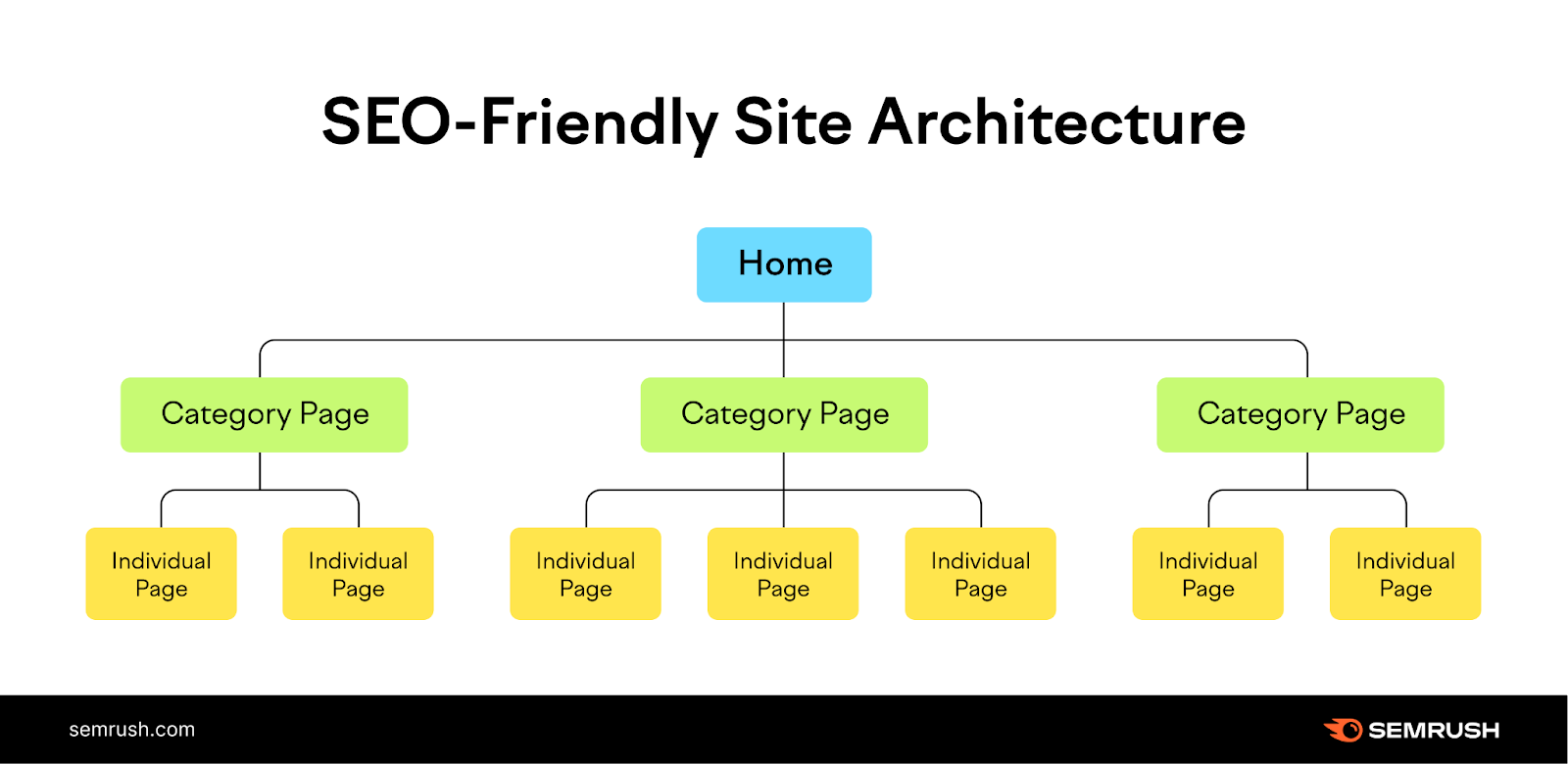

Wenn Sie sich in den frühen Stadien der Website-Entwicklung befinden, kann die Erstellung einer logischen Sitenstruktur auch helfen, eine starke Grundlage für interne Verlinkungen aufzubauen.

Eine logische Sitenstruktur organisiert Ihre Website in Kategorien. Dann verlinken diese Kategorien zu individuellen Seiten auf Ihrer Website.

So:

Die Startseite verbindet sich mit Seiten für jede Kategorie. Dann verbinden Seiten für jede Kategorie zu spezifischen Unterseiten auf der Website.

Indem Sie diese Struktur anpassen, bauen Sie eine solide Grundlage auf, damit Suchmaschinen Ihren Inhalt leicht navigieren und indexieren können.

Robots.txt

Robots.txt ist wie ein Türsteher am Eingang einer Party.

Es ist eine Datei auf Ihrer Website, die Suchmaschinen-Bots mitteilt, welche Seiten sie zugreifen können.

Hier ist eine Beispiel-Robots.txt-Datei:

User-agent: *

Allow:/blog/

Disallow:/blog/admin/

Lassen Sie uns jede Komponente dieser Datei verstehen.

- User-agent: *: Diese Zeile spezifiziert, dass die Regeln für alle Suchmaschinen-Bots gelten

- Allow: /blog/: Diese Direktive erlaubt Suchmaschinen-Bots, Seiten innerhalb des „/blog/“-Verzeichnisses zu crawlen. Mit anderen Worten, alle Blog-Beiträge dürfen gecrawlt werden

- Disallow: /blog/admin/: Diese Direktive weist Suchmaschinen-Bots an, das administrative Bereich des Blogs nicht zu crawlen

Wenn Suchmaschinen ihre Bots zu Ihrer Website schicken, um sie zu erkunden, prüfen sie zuerst die Robots.txt-Datei auf Einschränkungen.

Seien Sie vorsichtig, keine wichtigen Seiten versehentlich zu blocken, die Sie von Suchmaschinen gefunden haben wollen. Wie Ihre Blog-Beiträge und regulären Website-Seiten.

Auch wenn Robots.txt die Crawl-Zugänglichkeit steuert, hat es keinen direkten Einfluss auf die Indexierbarkeit Ihrer Website.

Suchmaschinen können immer noch Seiten entdecken und indexieren, die von anderen Websites verlinkt sind, auch wenn diese Seiten in der Robots.txt-Datei blockiert sind.

Um sicherzustellen, dass bestimmte Seiten, wie Pay-per-Click-Landingpages und „Danke“-Seiten, nicht indexiert werden, implementieren Sie ein „noindex“-Tag.

Lesen Sie unseren Leitfaden zum Meta-Robots-Tag, um mehr über dieses Tag und seine Implementierung zu erfahren.

XML-Sitemap

Ihre XML-Sitemap spielt eine entscheidende Rolle bei der Verbesserung der Crawlbarkeit und Indexierbarkeit Ihrer Website.

Sie zeigt Suchmaschinen-Bots alle wichtigen Seiten auf Ihrer Website, die Sie crawlen und indexieren lassen möchten.

Es ist wie das Geben einer Schatzkarte, um Ihren Inhalt leichter zu entdecken.

Fügen Sie also alle Ihre wesentlichen Seiten zu Ihrer Sitemap hinzu. Einschließlich solcher, die durch normale Navigation schwer zu finden sein könnten.

Das stellt sicher, dass Suchmaschinen-Bots Ihre Website effizient crawlen und indexieren können.

Inhaltsqualität

Die Inhaltsqualität beeinflusst, wie Suchmaschinen Ihre Website crawlen und indexieren.

Suchmaschinen-Bots lieben hochwertigen Inhalt. Wenn Ihr Inhalt gut geschrieben, informativ und relevant für Nutzer ist, kann er mehr Aufmerksamkeit von Suchmaschinen erregen.

Suchmaschinen möchten die besten Ergebnisse für ihre Nutzer liefern. Deshalb priorisieren sie das Crawlen und Indexieren von Seiten mit erstklassigem Inhalt.

Konzentrieren Sie sich darauf, originalen, wertvollen und gut geschriebenen Inhalt zu erstellen.

Verwenden Sie richtige Formatierung, klare Überschriften und eine organisierte Struktur, um es Suchmaschinen-Bots einfach zu machen, Ihren Inhalt zu crawlen und zu verstehen.

Für weitere Ratschläge zur Erstellung von erstklassigem Inhalt schauen Sie in unseren Leitfaden zur Qualitätsinhalt.

Technische Probleme

Technische Probleme können Suchmaschinen-Bots daran hindern, Ihre Website effektiv zu crawlen und zu indexieren.

Wenn Ihre Website langsame Ladezeiten, defekte Links oder Weiterleitungs-Schleifen hat, kann das die Fähigkeit der Bots behindern, Ihre Website zu navigieren.

Technische Probleme können Suchmaschinen auch daran hindern, Ihre Webseiten richtig zu indexieren.

Zum Beispiel, wenn Ihre Website Duplikat-Inhaltsprobleme hat oder kanonische Tags unsachgemäß verwendet, könnten Suchmaschinen Schwierigkeiten haben, zu verstehen, welche Version einer Seite sie indexieren und ranken sollen.

Solche Probleme sind schädlich für die Sichtbarkeit Ihrer Website in Suchmaschinen. Identifizieren und beheben Sie diese Probleme so schnell wie möglich.

Wie man Crawlbarkeits- und Indexierbarkeitsprobleme findet

Verwenden Sie das Site Audit-Tool von Semrush, um technische Probleme zu finden, die die Crawlbarkeit und Indexierbarkeit Ihrer Website beeinflussen.

Das Tool kann Ihnen helfen, Probleme wie folgende zu finden und zu beheben:

- Duplikat-Inhalt

- Weiterleitungs-Schleifen

- Defekte interne Links

- Server-seitige Fehler

Und mehr.

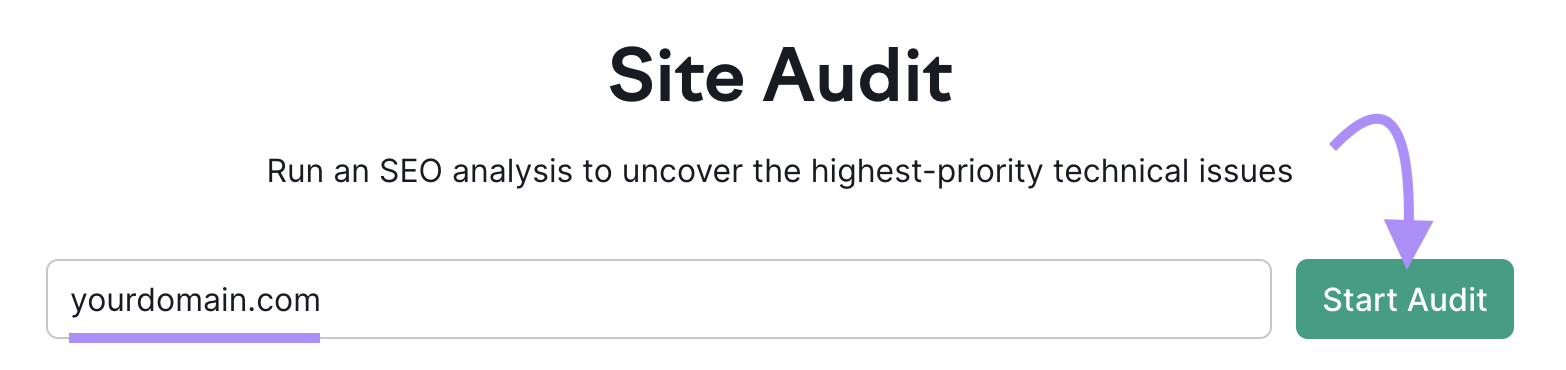

Um zu starten, geben Sie die URL Ihrer Website ein und klicken Sie auf „Audit starten“.

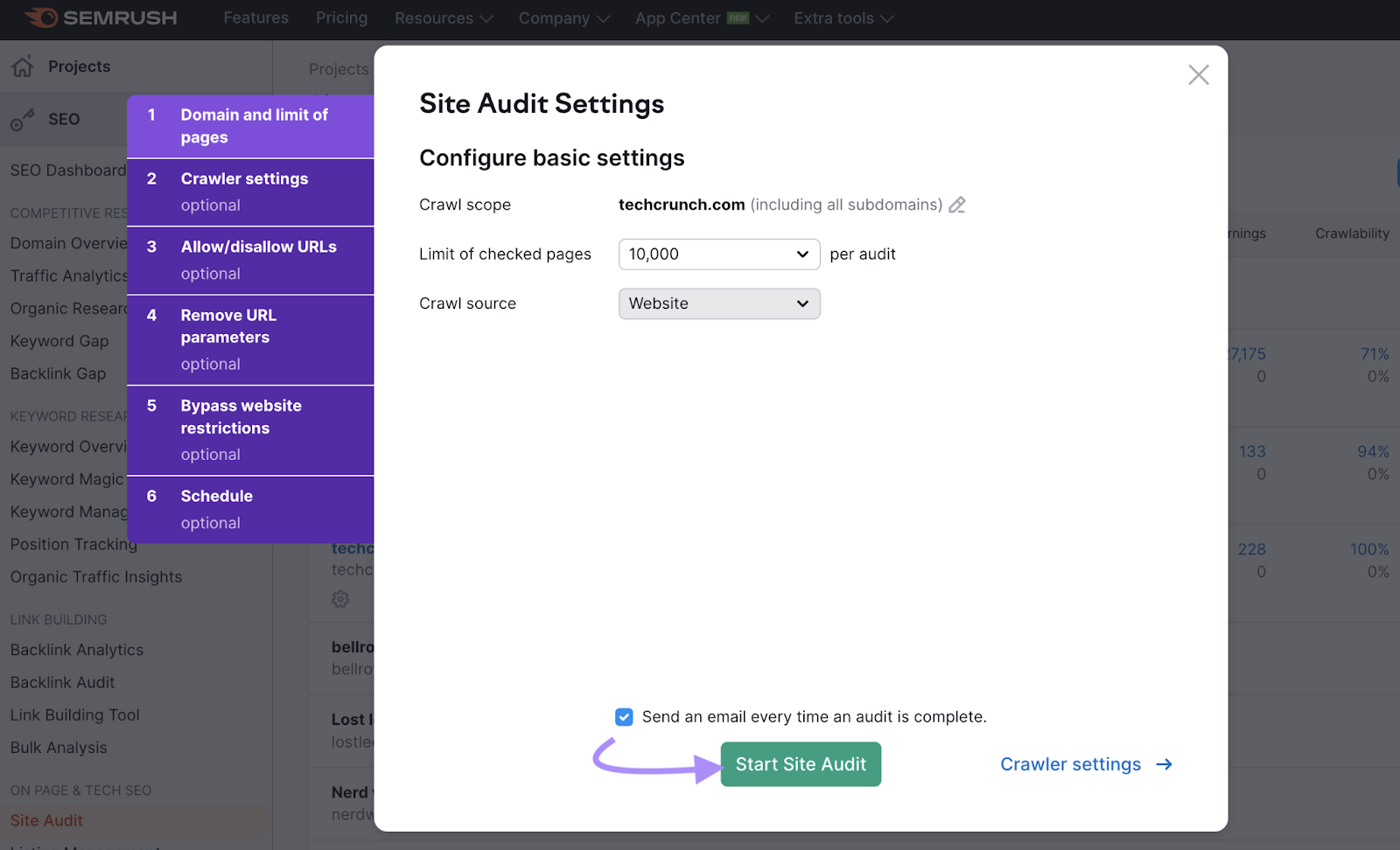

Als Nächstes konfigurieren Sie Ihre Audit-Einstellungen. Sobald Sie fertig sind, klicken Sie auf „Site Audit starten“.

Das Tool beginnt, Ihre Website auf technische Probleme zu prüfen. Nach Abschluss zeigt es eine Übersicht über die technische Gesundheit Ihrer Website mit einer „Site Health“-Metrik.