Rastreadibilidade & Indexabilidade: O Que São & Como Afetam o SEO

O Que É Rastreadibilidade?

A rastreadibilidade de uma página web refere-se à facilidade com que os mecanismos de busca (como o Google) podem descobrir a página.

O Google descobre páginas web por meio de um processo chamado rastreamento. Ele usa programas de computador chamados rastreadores web (também chamados de bots ou aranhas). Esses programas seguem links entre páginas para descobrir novas páginas ou atualizadas.

A indexação geralmente segue o rastreamento.

O Que É Indexabilidade?

A indexabilidade de uma página web significa que os mecanismos de busca (como o Google) são capazes de adicionar a página ao seu índice.

O processo de adicionar uma página web a um índice é chamado de indexação. Isso significa que o Google analisa a página e seu conteúdo e a adiciona a um banco de dados de bilhões de páginas (chamado de índice do Google).

Como a Rastreadibilidade e a Indexabilidade Afetam o SEO?

Tanto a rastreadibilidade quanto a indexabilidade são cruciais para o SEO.

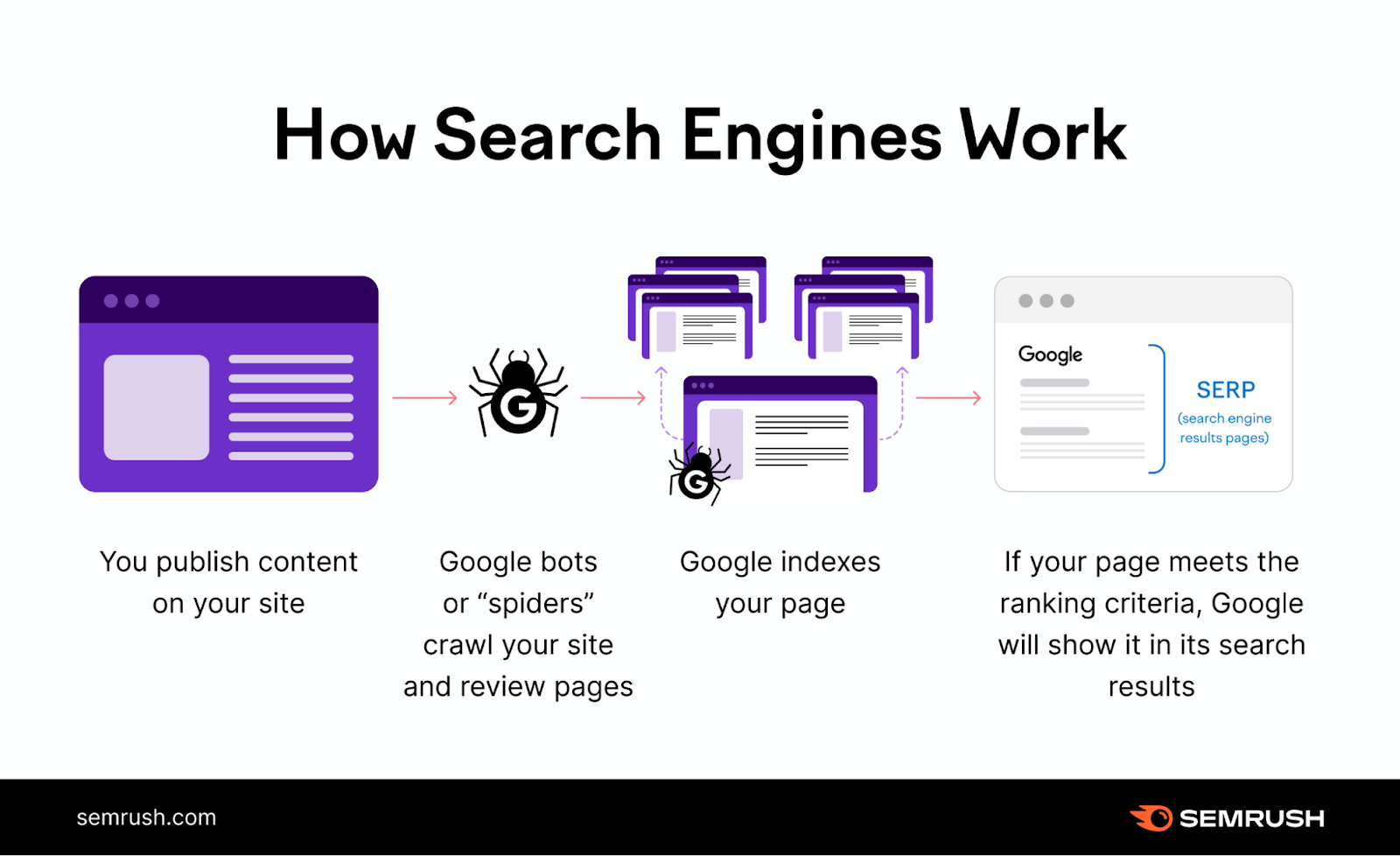

Aqui vai uma ilustração simples mostrando como o Google funciona:

Primeiro, o Google rastreia a página. Em seguida, ele a indexa. Somente então ele pode classificar a página para consultas de busca relevantes.

Em outras palavras: Sem ser rastreada e indexada primeiro, a página não será classificada pelo Google. Sem classificações = sem tráfego de busca.

Matt Cutts, ex-chefe de spam web do Google, explica o processo neste vídeo:

Não é surpresa que uma parte importante do SEO seja garantir que as páginas do seu site sejam rastreáveis e indexáveis.

Mas como fazer isso?

Comece realizando uma auditoria de SEO técnico do seu site.

Use a ferramenta Site Audit do Semrush para ajudá-lo a descobrir problemas de rastreadibilidade e indexabilidade. (Abordaremos isso em detalhes mais adiante neste post.)

Detecte Problemas de Rastreadibilidade e Indexabilidade

com a Ferramenta Site Audit

O Que Afeta a Rastreadibilidade e a Indexabilidade?

Links Internos

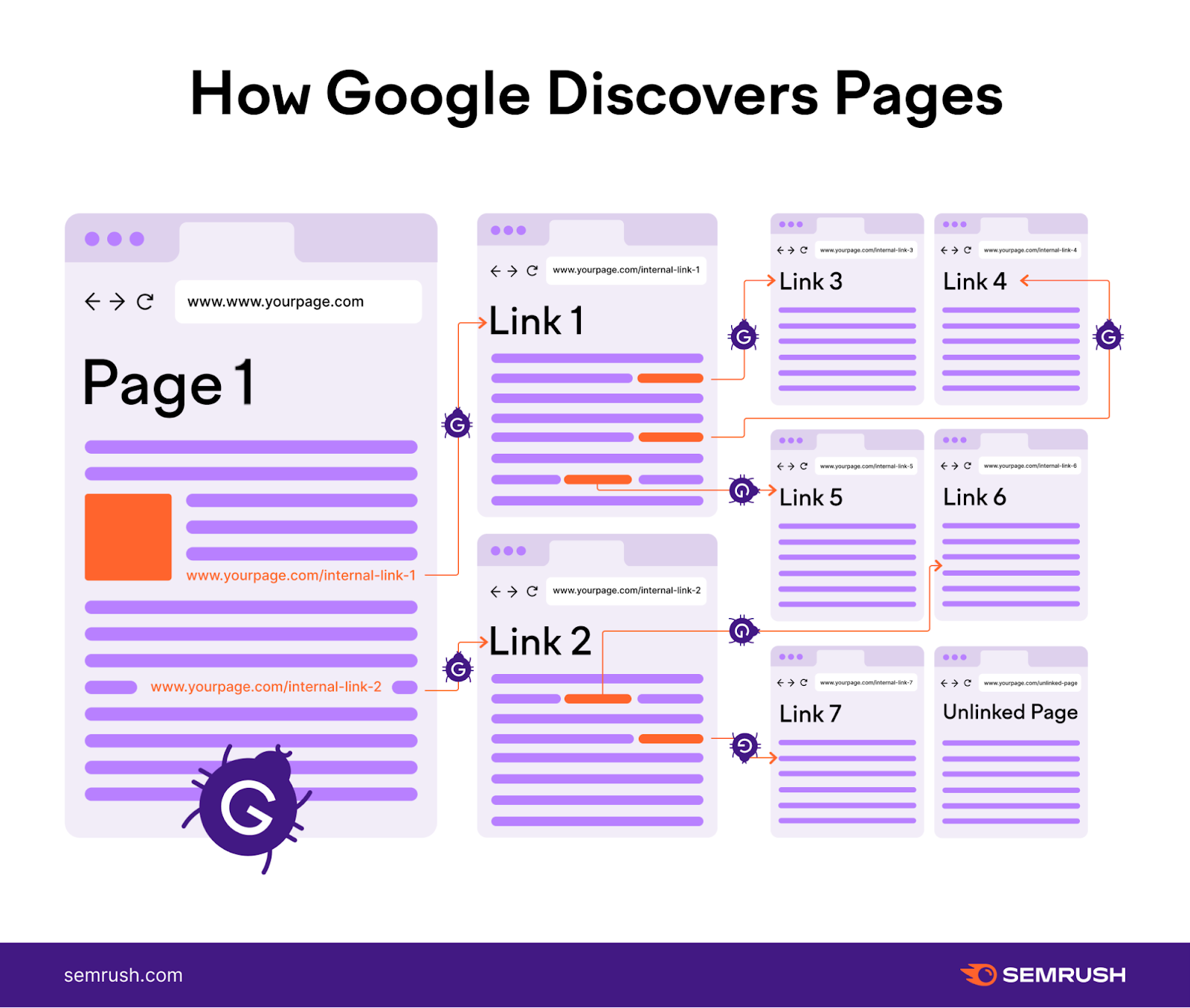

Os links internos têm um impacto direto na rastreadibilidade e indexabilidade do seu site.

Lembre-se — os mecanismos de busca usam bots para rastrear e descobrir páginas web. Os links internos atuam como um mapa, guiando os bots de uma página para outra dentro do seu site.

Links internos bem posicionados facilitam para os bots dos mecanismos de busca encontrar todas as páginas do seu site.

Portanto, garanta que toda página do seu site esteja vinculada de algum lugar dentro do seu site.

Comece incluindo um menu de navegação, links no rodapé e links contextuais dentro do seu conteúdo.

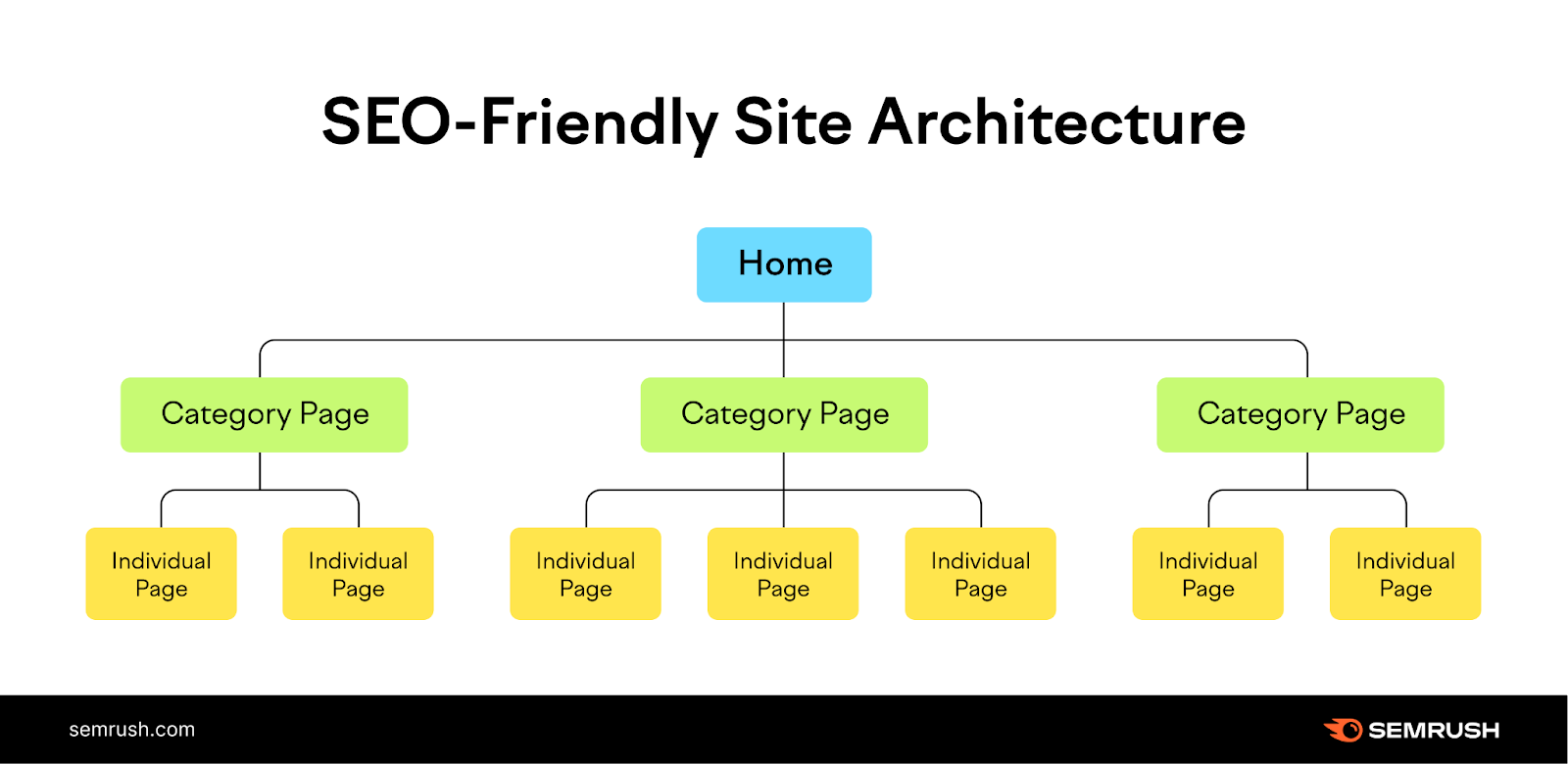

Se você estiver nas etapas iniciais do desenvolvimento do site, criar uma estrutura lógica de site também pode ajudá-lo a estabelecer uma base sólida de links internos.

Uma estrutura lógica de site organiza seu site em categorias. Em seguida, essas categorias vinculam para páginas individuais no seu site.

Como assim:

A página inicial se conecta a páginas para cada categoria. Em seguida, as páginas para cada categoria se conectam a subpáginas específicas no site.

Ao adotar essa estrutura, você construirá uma base sólida para que os mecanismos de busca naveguem e indexem seu conteúdo facilmente.

Robots.txt

O robots.txt é como um porteiro na entrada de uma festa.

É um arquivo no seu site que diz aos bots dos mecanismos de busca quais páginas eles podem acessar.

Aqui vai um exemplo de arquivo robots.txt:

User-agent: *

Allow:/blog/

Disallow:/blog/admin/

Vamos entender cada componente deste arquivo.

- User-agent: *: Esta linha especifica que as regras se aplicam a todos os bots dos mecanismos de busca

- Allow: /blog/: Esta diretiva permite que os bots dos mecanismos de busca rastreiem páginas dentro do diretório “/blog/”. Em outras palavras, todos os posts do blog são permitidos para rastreamento

- Disallow: /blog/admin/: Esta diretiva diz aos bots dos mecanismos de busca para não rastrearem a área administrativa do blog

Quando os mecanismos de busca enviam seus bots para explorar seu site, eles primeiro verificam o arquivo robots.txt para checar restrições.

Tenha cuidado para não bloquear acidentalmente páginas importantes que você quer que os mecanismos de busca encontrem. Como seus posts do blog e páginas regulares do site.

Além disso, embora o robots.txt controle a acessibilidade de rastreamento, ele não impacta diretamente a indexabilidade do seu site.

Os mecanismos de busca ainda podem descobrir e indexar páginas que são vinculadas de outros sites, mesmo se essas páginas estiverem bloqueadas no arquivo robots.txt.

Para garantir que certas páginas, como páginas de destino de pay-per-click (PPC) e páginas de “obrigado”, não sejam indexadas, implemente uma tag “noindex”.

Leia nosso guia sobre meta robots tag para aprender sobre esta tag e como implementá-la.

Mapa do Site XML

Seu mapa do site XML tem um papel crucial na melhoria da rastreadibilidade e indexabilidade do seu site.

Ele mostra aos bots dos mecanismos de busca todas as páginas importantes do seu site que você quer que sejam rastreadas e indexadas.

É como dar a eles um mapa do tesouro para descobrir seu conteúdo mais facilmente.

Portanto, inclua todas as suas páginas essenciais no seu sitemap. Incluindo aquelas que podem ser difíceis de encontrar por meio da navegação regular.

Isso garante que os bots dos mecanismos de busca possam rastrear e indexar seu site de forma eficiente.

Qualidade do Conteúdo

A qualidade do conteúdo impacta como os mecanismos de busca rastreiam e indexam seu site.

Os bots dos mecanismos de busca adoram conteúdo de alta qualidade. Quando seu conteúdo é bem escrito, informativo e relevante para os usuários, ele pode atrair mais atenção dos mecanismos de busca.

Os mecanismos de busca querem entregar os melhores resultados para seus usuários. Então, eles priorizam o rastreamento e indexação de páginas com conteúdo de primeira linha.

Concentre-se em criar conteúdo original, valioso e bem escrito.

Use formatação adequada, títulos claros e estrutura organizada para facilitar que os bots dos mecanismos de busca rastreiem e entendam seu conteúdo.

Para mais conselhos sobre criar conteúdo de primeira linha, confira nosso guia sobre qualidade de conteúdo.

Problemas Técnicos

Problemas técnicos podem impedir que os bots dos mecanismos de busca rastreiem e indexem seu site de forma eficaz.

Se o seu site tiver tempos de carregamento de página lentos, links quebrados ou loops de redirecionamento, isso pode dificultar a capacidade dos bots de navegar no seu site.

Problemas técnicos também podem impedir que os mecanismos de busca indexem adequadamente suas páginas web.

Por exemplo, se o seu site tiver problemas de conteúdo duplicado ou estiver usando tags canônicas de forma inadequada, os mecanismos de busca podem ter dificuldade em entender qual versão de uma página indexar e classificar.

Problemas como esses são prejudiciais à visibilidade do seu site nos mecanismos de busca. Identifique e corrija esses problemas o mais rápido possível.

Como Encontrar Problemas de Rastreadibilidade e Indexabilidade

Use a ferramenta Site Audit do Semrush para encontrar problemas técnicos que afetam a rastreadibilidade e indexabilidade do seu site.

A ferramenta pode ajudá-lo a encontrar e corrigir problemas como:

- Conteúdo duplicado

- Loops de redirecionamento

- Links internos quebrados

- Erros do lado do servidor

E mais.

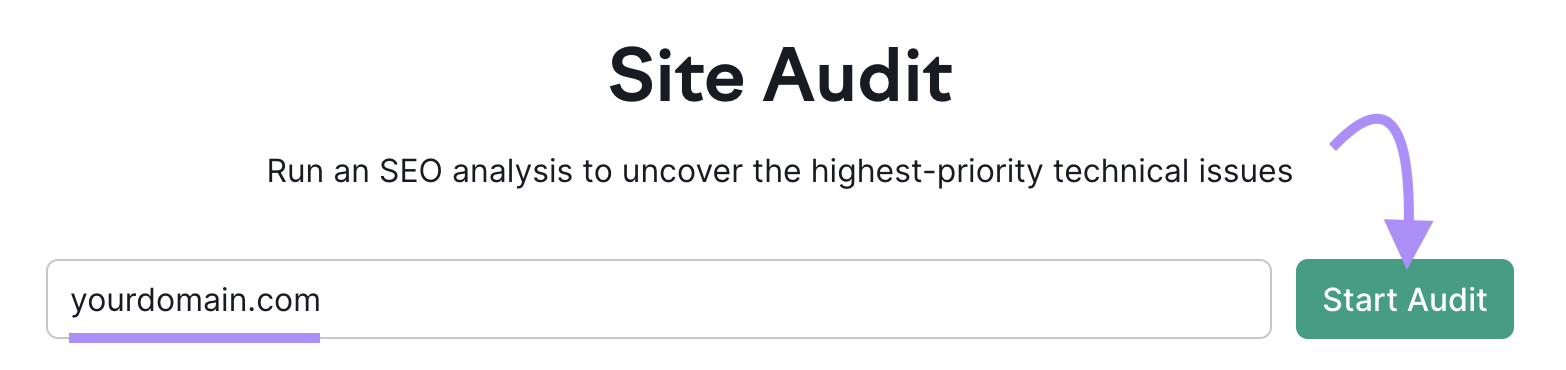

Para começar, insira a URL do seu site e clique em “Iniciar Auditoria.”

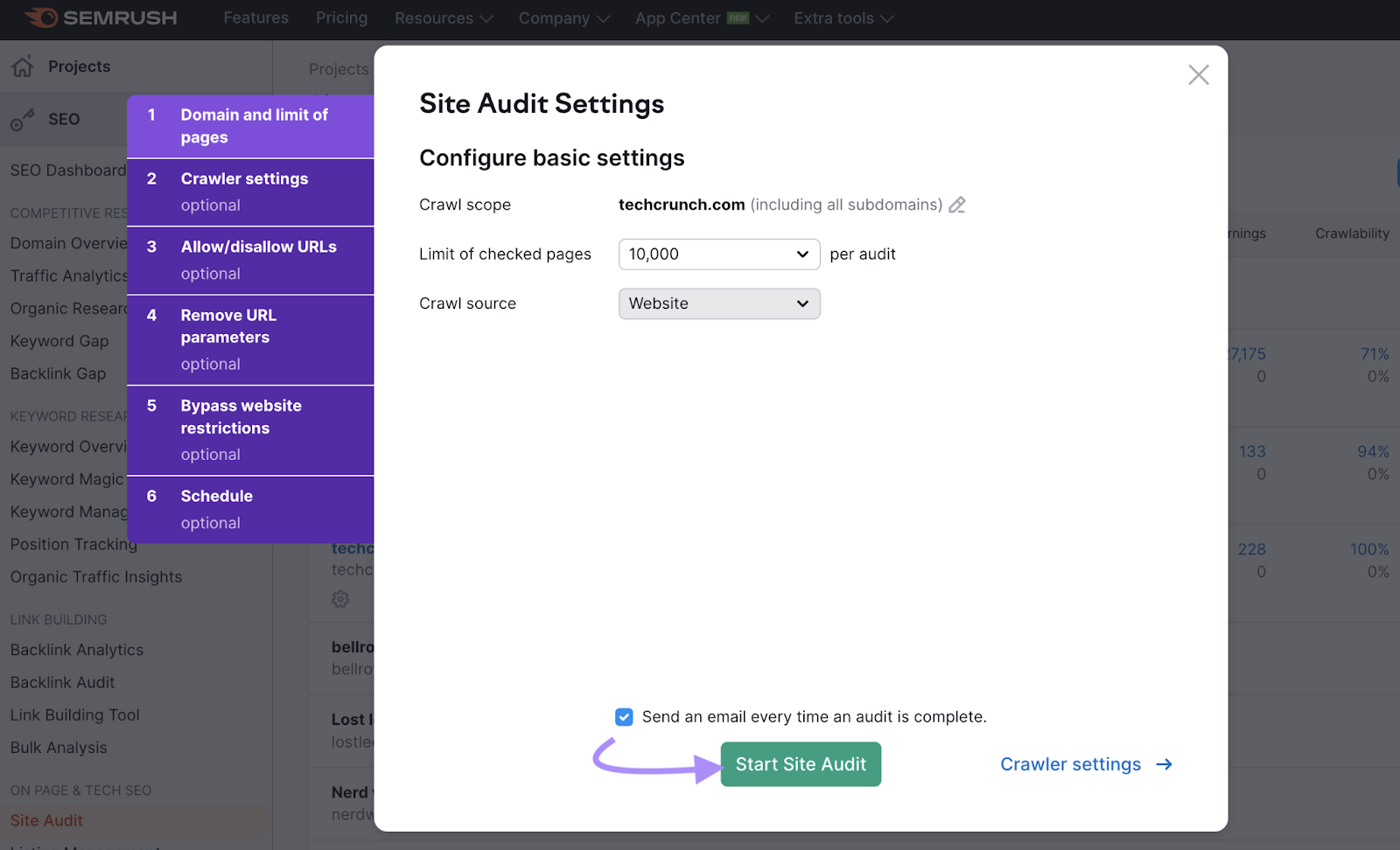

Em seguida, configure as configurações da sua auditoria. Uma vez feito, clique em “Iniciar Auditoria do Site.”

A ferramenta começará a auditar seu site em busca de problemas técnicos. Após a conclusão, ela mostrará uma visão geral da saúde técnica do seu site com uma métrica de “Saúde do Site”.