クローラビリティとインデクサビリティ:それらは何で、SEOにどのように影響するか

クローラビリティとは何ですか?

ウェブページのクローラビリティとは、検索エンジン(Googleなど)がそのページをどれだけ簡単に発見できるかを指します。

Googleはクローリングと呼ばれるプロセスを通じてウェブページを発見します。ウェブクローラー(ボットやスパイダーと呼ばれることもある)というコンピューター プログラムを使用します。これらのプログラムは、ページ間のリンクをたどって新しいページや更新されたページを発見します。

インデクシングは通常、クローリングの後に続きます。

インデクサビリティとは何ですか?

ウェブページのインデクサビリティとは、検索エンジン(Googleなど)がそのページをインデックスに追加できることを意味します。

ウェブページをインデックスに追加するプロセスをインデクシングと呼びます。これは、Googleがページとそのコンテンツを分析し、何十億ものページのデータベース(Googleインデックスと呼ばれる)に追加することを意味します。

クローラビリティとインデクサビリティはSEOにどのように影響しますか?

クローラビリティとインデクサビリティの両方は、SEOにとって重要です。

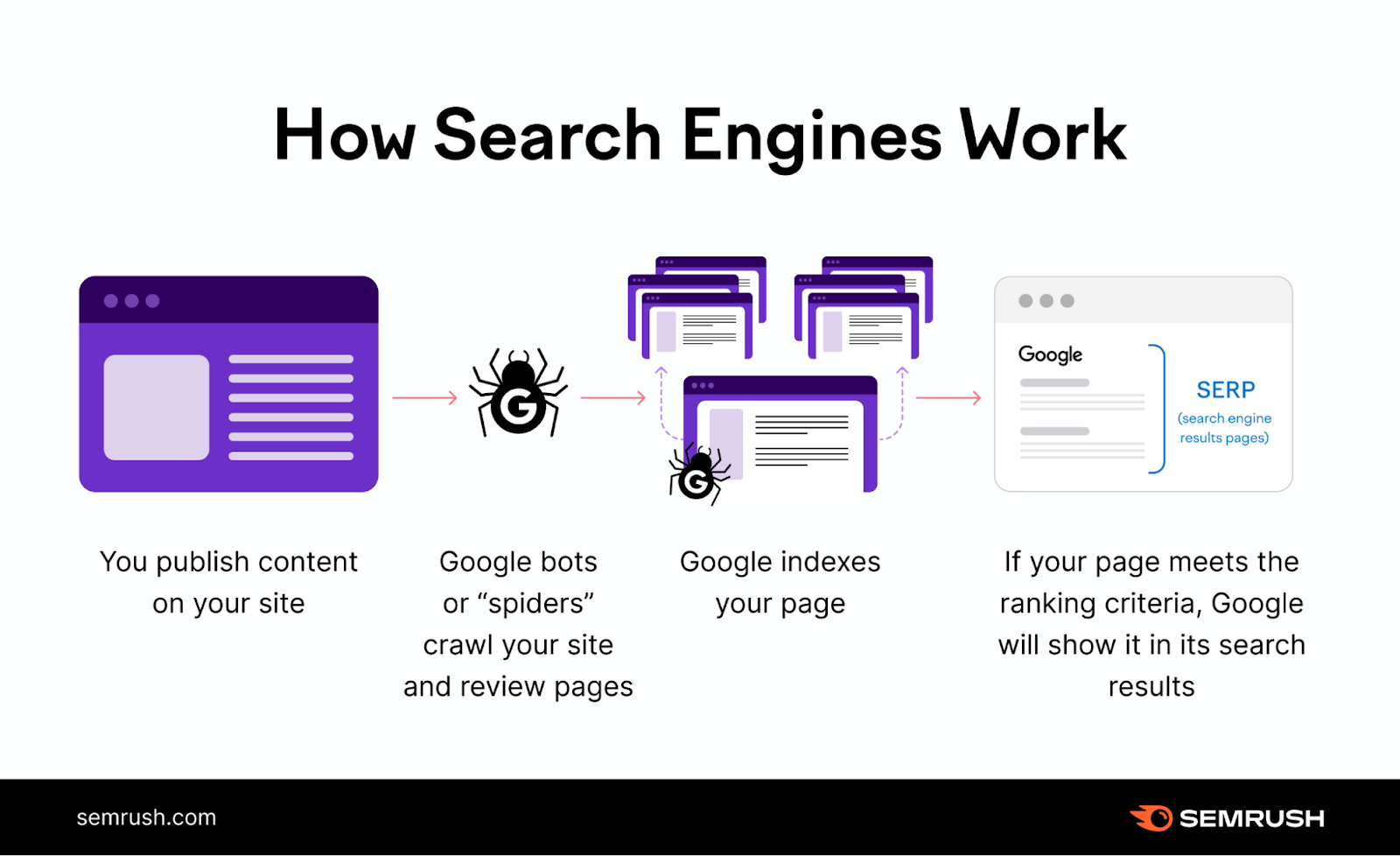

Googleの動作を示す簡単なイラストを以下に示します:

まず、Googleはページをクローリングします。次にインデックスします。それから、関連する検索クエリに対してページをランク付けできます。

言い換えれば:まずクローリングとインデクシングされなければ、ページはGoogleによってランク付けされません。ランクなし = 検索トラフィックなし。

Googleの元ウェブスパム責任者であるMatt Cuttsがこのビデオでプロセスを説明しています:

SEOの重要な部分が、ウェブサイトのページがクローラブルでインデクサブルであることを確認することであるのは驚くことではありません。

しかし、どうやってそれを行いますか?

まず、ウェブサイトのテクニカルSEO監査を実施してください。

SemrushのSite Auditツールを使用して、クローラビリティとインデクサビリティの問題を発見するのに役立ててください。(この投稿の後半で詳細に説明します。)

クローラビリティとインデクサビリティの問題を検出

Site Auditツールで

クローラビリティとインデクサビリティに影響するものは何ですか?

内部リンク

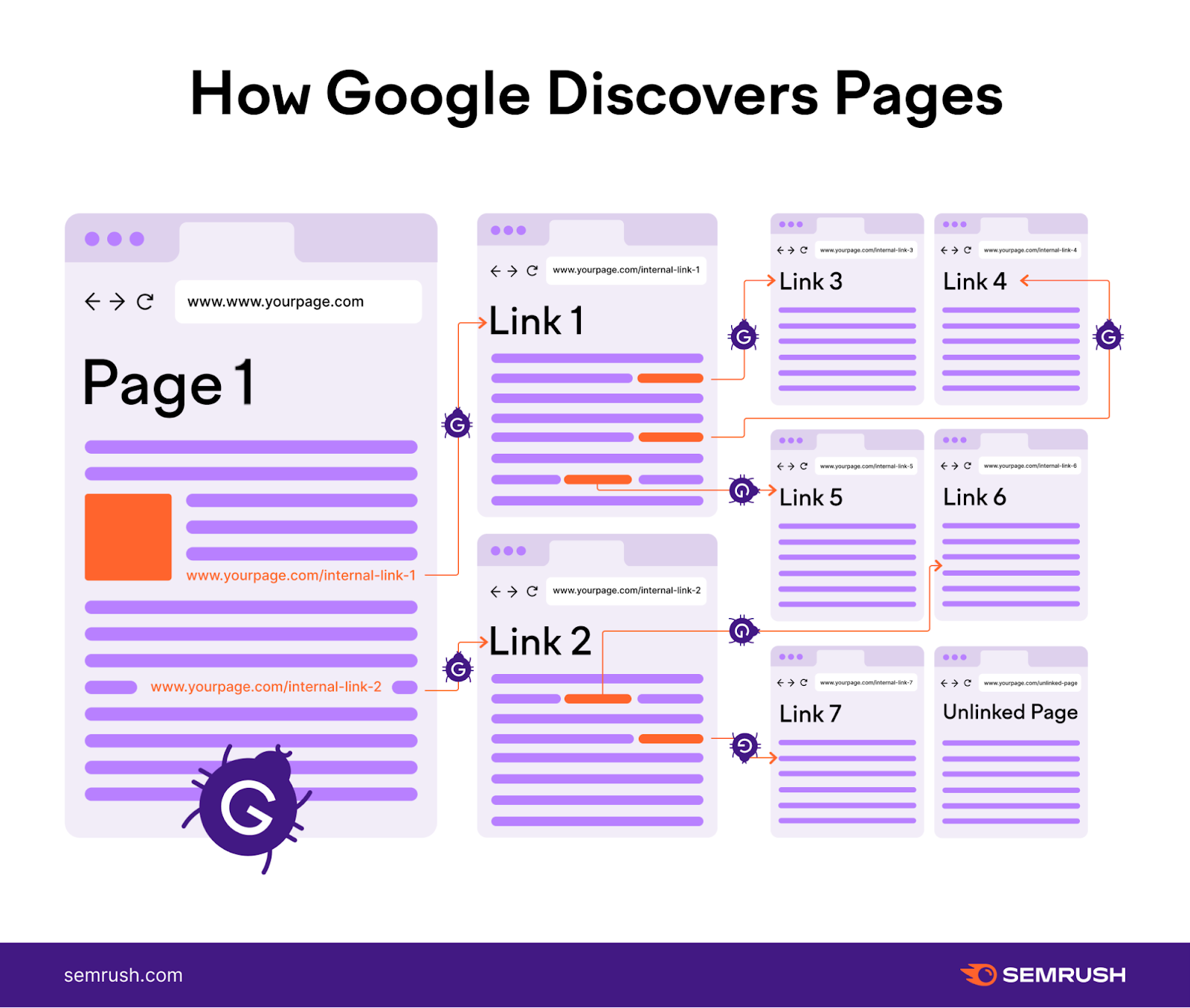

内部リンクは、ウェブサイトのクローラビリティとインデクサビリティに直接影響します。

覚えておいてください—検索エンジンはボットを使用してウェブページをクローリングして発見します。内部リンクはロードマップとして機能し、ボットをウェブサイト内のページから別のページへ導きます。

適切に配置された内部リンクは、検索エンジンのボットがウェブサイトのすべてのページを見つけやすくします。

したがって、サイト上のすべてのページがウェブサイト内のどこかからリンクされていることを確認してください。

まず、ナビゲーションメニュー、フッターリンク、コンテンツ内のコンテキストリンクを含めてください。

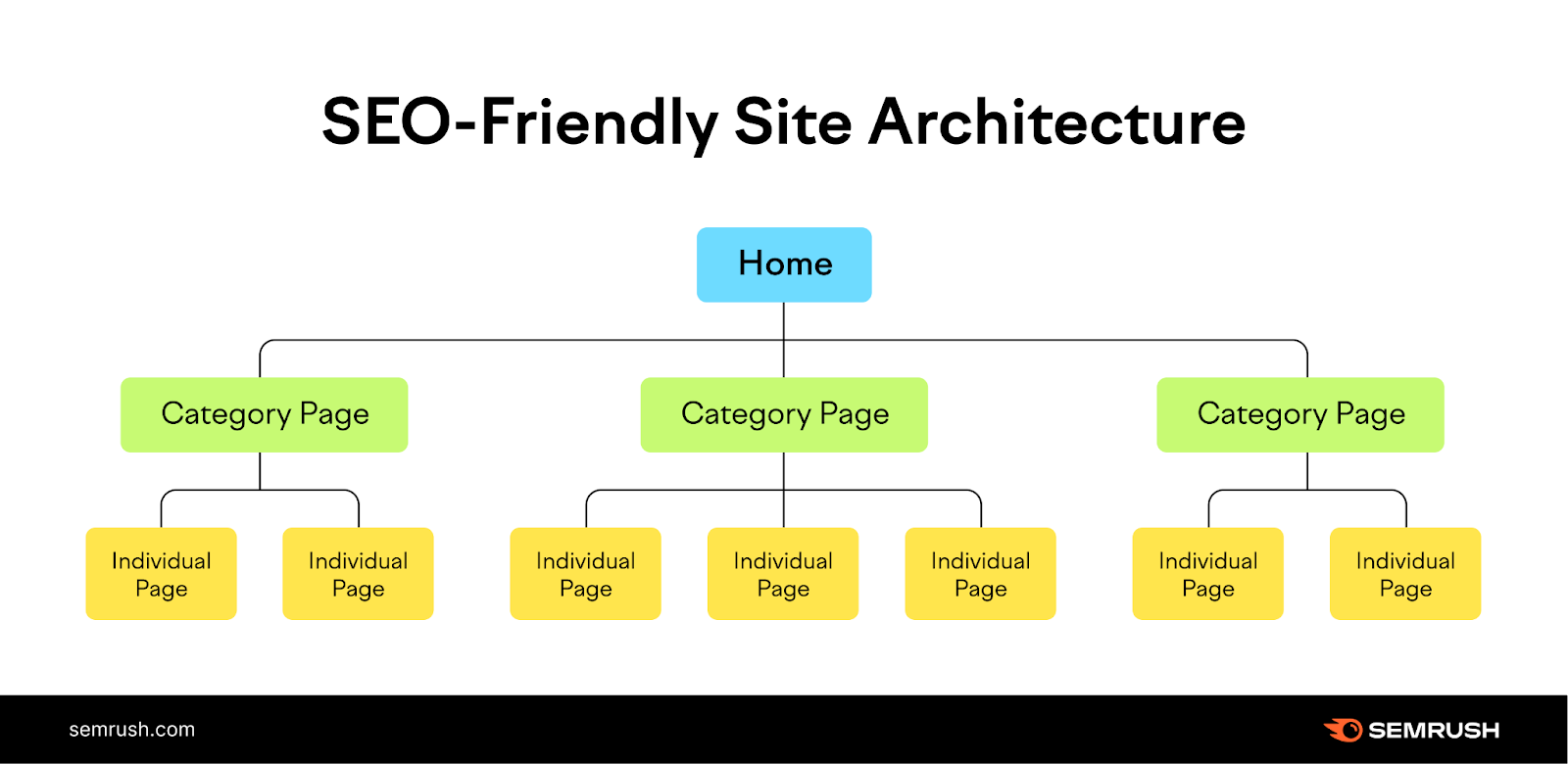

ウェブサイト開発の初期段階にある場合、論理的なサイト構造を作成することで、強固な内部リンクの基盤を構築するのに役立ちます。

論理的なサイト構造は、ウェブサイトをカテゴリに整理します。そして、それらのカテゴリがサイト上の個別のページにリンクします。

以下のように:

ホームページが各カテゴリのページに接続します。そして、各カテゴリのページがサイト上の特定のサブページに接続します。

この構造を採用することで、検索エンジンがコンテンツを簡単にナビゲートしてインデックスできる強固な基盤を構築できます。

Robots.txt

Robots.txtは、パーティーの入り口にいる用心棒のようなものです。

ウェブサイト上のファイルで、検索エンジンのボットがどのページにアクセスできるかを指示します。

以下はrobots.txtファイルのサンプルです:

User-agent: *

Allow:/blog/

Disallow:/blog/admin/

このファイルの各コンポーネントを理解しましょう。

- User-agent: *:この行は、ルールがすべての検索エンジンボットに適用されることを指定します

- Allow: /blog/:このディレクティブは、検索エンジンボットが「/blog/」ディレクトリ内のページをクローリングすることを許可します。つまり、すべてのブログ投稿がクローリング可能になります

- Disallow: /blog/admin/:このディレクティブは、検索エンジンボットがブログの管理領域をクローリングしないように指示します

検索エンジンがボットをウェブサイトに送る際、まずrobots.txtファイルを確認して制限をチェックします。

検索エンジンに見つけてもらいたい重要なページ(例:ブログ投稿や通常のウェブサイトページ)を誤ってブロックしないように注意してください。

また、robots.txtはクロールアクセシビリティを制御しますが、ウェブサイトのインデクサビリティに直接影響しません。

検索エンジンは、robots.txtでブロックされたページでも、他のウェブサイトからリンクされたページを発見してインデックスできます。

特定のページ(例:ペイパークリック(PPC)のランディングページや「ありがとう」ページ)がインデックスされないようにするには、「noindex」タグを実装してください。

このタグとその実装方法については、meta robotsタグのガイドをお読みください。

XML Sitemap

XML sitemapは、ウェブサイトのクローラビリティとインデクサビリティを向上させる上で重要な役割を果たします。

検索エンジンボットに、クローリングしてインデックスしてほしいウェブサイトの重要なすべてのページを示します。

それは、コンテンツをより簡単に発見するための宝の地図を与えるようなものです。

したがって、sitemapにすべての重要なページを含めてください。通常のナビゲーションでは見つけにくいページも含めて。

これにより、検索エンジンボットがサイトを効率的にクローリングしてインデックスできます。

コンテンツの品質

コンテンツの品質は、検索エンジンがウェブサイトをクローリングしてインデックスする方法に影響します。

検索エンジンボットは高品質のコンテンツが大好きです。コンテンツがよく書かれていて、情報があり、ユーザーに適している場合、検索エンジンからより多くの注目を集めることができます。

検索エンジンはユーザーに最高の結果を提供したいので、最高のコンテンツを持つページのクローリングとインデックスを優先します。

オリジナルで価値があり、よく書かれたコンテンツを作成することに焦点を当ててください。

適切なフォーマット、明確な見出し、整理された構造を使用して、検索エンジンボットがコンテンツを簡単にクローリングして理解できるようにします。

最高のコンテンツを作成するアドバイスについては、品質コンテンツのガイドを参照してください。

テクニカルな問題

テクニカルな問題は、検索エンジンボットがウェブサイトを効果的にクローリングしてインデックスするのを妨げます。

ウェブサイトにページの読み込みが遅い、壊れたリンク、リダイレクトループがある場合、ボットのナビゲーション能力を妨げます。

テクニカルな問題は、検索エンジンがウェブページを適切にインデックスするのを妨げることもあります。

たとえば、ウェブサイトに重複コンテンツの問題やcanonicalタグの不適切な使用がある場合、検索エンジンはどのバージョンのページをインデックスしてランク付けするかを理解するのに苦労します。

これらのような問題は、ウェブサイトの検索エンジンでの視認性に悪影響を及ぼします。これらの問題をできるだけ早く特定して修正してください。

クローラビリティとインデクサビリティの問題を見つける方法

SemrushのSite Auditツールを使用して、ウェブサイトのクローラビリティとインデクサビリティに影響するテクニカルな問題を見つけましょう。

このツールは、以下のような問題を見つけ、修正するのに役立ちます:

- 重複コンテンツ

- リダイレクトループ

- 壊れた内部リンク

- サーバー側のエラー

そして他にも。

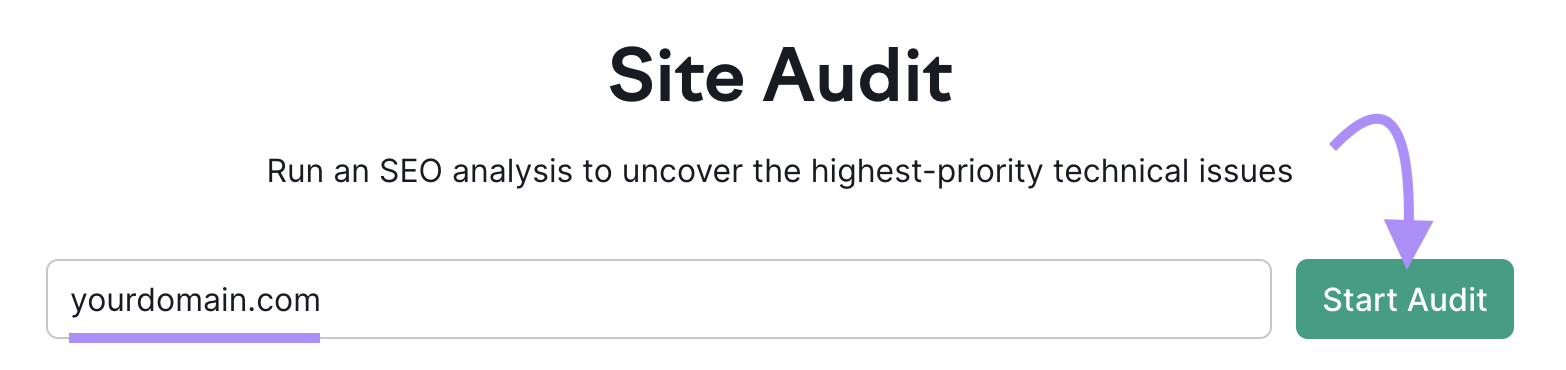

開始するには、ウェブサイトのURLを入力し、「監査を開始」をクリックします。

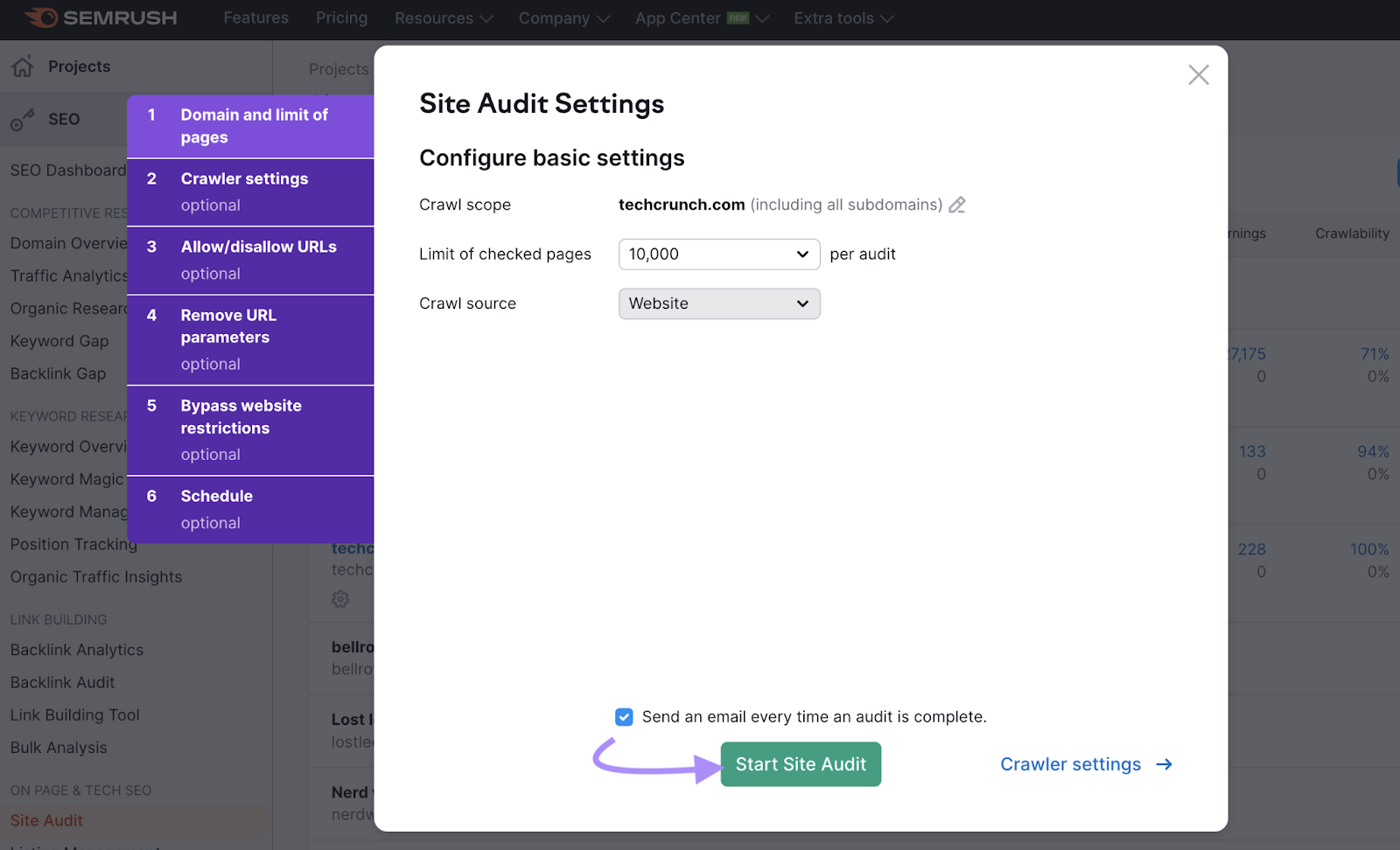

次に、監査設定を構成します。完了したら、「Site Auditを開始」をクリックします。

ツールはウェブサイトをテクニカルな問題で監査し始めます。完了後、ウェブサイトのテクニカルヘルスの概要を示し、「Site Health」メトリクスを表示します。